搭建本地 AI 大模型 deepseek,并使用 Web 界面调用

Deepseek提供支持

Deepseek提供支持1.如何部署

1.1安装 ollama

- 本地运行: 数据无需上传到云端,保护隐私和安全

- 简单易用: 提供命令行工具,无需复杂配置

- 多模型支持: 支持多种开源大语言模型

- 跨平台: 支持 Windows、Linux 和 macOS

- 开源免费: Ollama 是开源工具,用户可以免费使用和修改

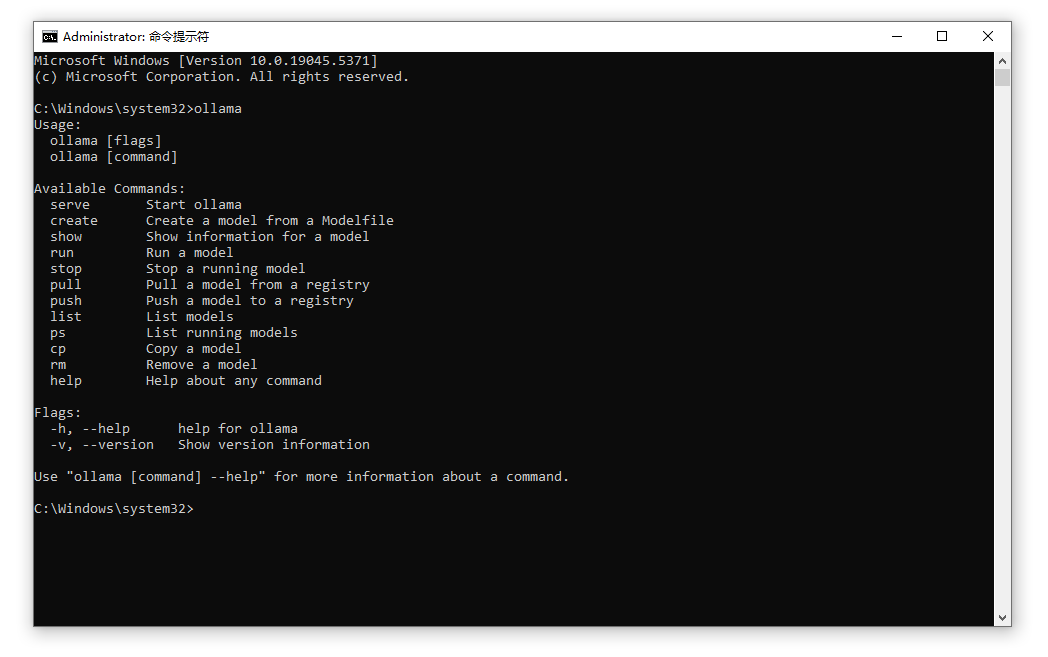

下载完成且安装完毕之后,打开CMD命令,输入ollama检测是否已经成功安装ollama

1.2 Ollama运行且安装Deepseek模型

前往Ollama网站,找到对应想要安装的模型;我这里机器条件限制,默认使用1.5B模型。访问https://ollama.com/library/deepseek-r1以获取想要下载的模型,有不同参数量的模型可供考虑,对计算机存储的要求也不同,这里选择参数量为8b的模型,这样虽然推理能力不咋样,文字生成速度还行。

版本:1.5b,适用于一般文字编辑使用(需要1.1GB空余空间)

ollama run deepseek-r1:1.5b

版本:7b,DeepSeek的第一代推理模型,性能与OpenAl-01相当,包括从基于Llama和Qwen的DeepSeek-R1中提取的六个密集模型(需要

4.7GB空余空间)

ollama run deepseek-r1:7b

版本:8b,(需要4.9GB空余空间)

ollama run deepseek-r1:8b

版本:14b,(需要9GB空余空间)

ollama run deepseek-r1:14b

版本:32b,(需要20GB空余空间)

ollama run deepseek-r1:32b

版本:70b,(需要43GB空余空间)

ollama run deepseek-r1:70b

版本:671b,(需要404GB空余空间)

ollama run deepseek-r1:671b2.部署Open web-ui

可以使用 Python 包管理器 pip 安装 Open WebUI。确保使用的是Python 3.11 版本

安装 Open WebUI:打开终端并运行以下命令来安装 Open WebUI:

pip install open-webui 1.3运行 Open WebUI:

安装完成后,您可以通过执行以下命令启动 Open WebUI:

open-webui serve 这将启动 Open WebUI 服务器,您可以通过http://localhost:8080访问它。

注意:8080 端口被占用!如何解决

打开管理员权限的命令提示符(CMD),执行以下步骤:

查找占用8080端口的进程PID

netstat -ano | findstr :8080

示例输出:

TCP 0.0.0.0:8080 0.0.0.0:0 LISTENING 1234

第二步:

taskkill /F /PID 1234使用其他端口访问Open-WebUI

# 使用8081端口启动

open-webui serve --port 8081

# 也可以用8888端口

open-webui serve --port 88882.访问WebUI

然后再通过浏览器访问http://localhost:8081

选择本地模型:

打开浏览器,访问你的 open-webui;

首次进入会让你创建管理员账号,完成后登录;

点击页面右上角的 设置图标(齿轮) → 选择 Settings(设置) → 左侧菜单选择 Models(模型)

文章链接:https://www.lilianhua.com/build-a-local-ai-large-model-demo-and-use-the-web.html